美攝科技張瑞全:拓展AIGC+數字人的想象空間

隨著人工智能的快速發展,視音頻技術也迎來了蓬勃的發展期。3月31日至4月1日,國內音視頻領域盛會LiveVideoStackCon在北京成功舉辦,眾多業內企業、技術專家和學者齊聚一堂,共同探討多媒體音視頻技術在技術升級、業務場景和應用創新等方面的實踐和探索。作為視音頻技術領域的代表企業之一,北京美攝網絡科技有限公司連續六年參會,展示了在AIGC、數字人等領域的領先成果,展現了美攝科技的技術實力和創新能力。

美攝科技研發中心高級AI算法專家張瑞全出席活動,并圍繞數字化內容生產快速落地分享了自己的見解。

美攝AIGC數字人基于虛擬視頻合成技術,通過綜合利用計算機視覺、圖像處理和深度學習等技術,可以在無實物的條件下生成虛擬視頻。目前主要有三種視頻生成技術:語音驅動、動作驅動以及換臉。目前主要存在兩個技術難點:一是表情和口型預測,合成視頻容易出現音色改變、口型抖動、口型失真等干擾;二是視頻幀渲染,如何實現真實面部渲染、防止表情失真,如何獲取訓練數據,都是要解決的問題。

張瑞全向與會者介紹了美攝研發中心實現表情和口型預測、3D人臉渲染及合成的技術原理,并詳細比較了不同方法的優缺點。據他介紹,美攝科技研發團隊已經拿出了相對成熟的技術方案,實現了逼真的虛擬視頻合成效果。

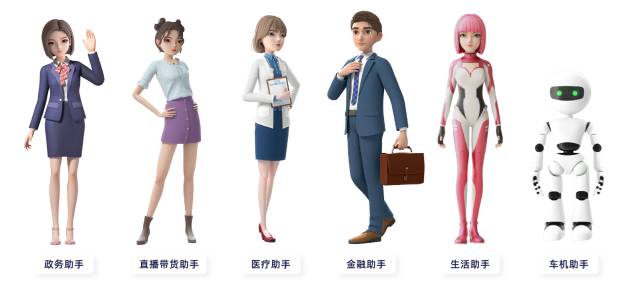

以此為依托,張瑞全團隊開發出多種借助AI技術快速生成數字人形象的產品應用,包括照片自動生成形象、視頻自動生成形象以及GLB模型自動轉換形象三種方式。操作者只需上傳一張照片或一段視頻,錄入預設的文本內容,系統就可以自動生成對應的數字人形象,并配以逼真的語音播報口型,大大縮短制作周期。

他特別提到,以GLB生成數字人形象時,可以將其轉換為美攝自研的3D文件格式“.ARSCENE”,轉換后的效果包可以通過MeisheSDK在不同的平臺上實時渲染驅動。GLB文件是以圖形語言傳輸格式保存的3D模型,它以二進制格式存儲有關3D模型的信息,包括節點層級、攝像機、材質、動畫和網格。

而談到近來大熱的ChatGPT,張瑞全表示團隊目前主要關注兩個應用方向。一是智能數字人語音助手,將ChatGPT的混合語義理解能力和美攝已有的語音交互系統相結合,當用戶提問一些開放性問題時,數字人助手可以給出更好的回答。二是將ChatGPT、視頻剪輯和數字人相結合,用戶只需填寫一句話,設定好要求,系統就可以通過ChatGPT返回分鏡腳本,并從中提取所需標簽,由系統從媒資庫中智能尋找對應的圖像和視頻資料。用戶可以選擇推薦素材,一鍵套用模板,直接形成預覽視頻,極大提高視頻創作效率。

據張瑞全分享,美攝科技的AIGC數字人方案已經成功落地于多個一線品牌,在智能汽車、智能手表、智能手機、社交軟件等領域的產品中都取得了出色的應用效果,為這些產品注入了更多創新和智能化元素。